Все мы знаем так называемый закон Мура: количество транзисторов, размещаемых на кристалле интегральной схемы, удваивается каждые 2 года. Конечно, верность этого закона под вопросом. Учитывая, что это всего лишь эмпирическое наблюдение, оно и не может быть точным. Но факт остается фактом: каждый год выходят новые, более производительные модели процессоров.

Популярным решением для хостингов являются серверы на базе процессоров Intel. На проекте FirstVDS мы используем серверные платформы на процессорах Intel Xeon E5-2630. В 2014 году мы начали переход со второй версии процессора (v2, Ivy Bridge) на третью версию (v3, Haswell). Уже в следующем году выйдет 4-я версия процессора под кодовым названием Broadwell, однако Haswell останется актуальным ещё долгое время.

Давайте подробнее рассмотрим особенности процессора Intel Xeon E5-2630v3, спроектированного для высокопроизводительных вычислений.

Сравним с предыдущим поколением

Собираем следующие конфигурации серверов:

| Старая конфигурация v2 (Ivy Bridge) | Новая конфигурация v3 (Haswell) |

| 2х E5-2630v2 | 2х E5-2630v3 |

| 128 GB ОЗУ | 128 GB ОЗУ |

| 2x SSD 960 GB | 2x SSD 960 GB |

| Стоимость: 28 914 руб. | Стоимость: 29 940 руб. |

Как видим, стоимость сервера с процессорами поколения v3 незначительно отличается от v2. Но есть ли прирост производительности? Постараемся выяснять этот вопрос.

Технические характеристики процессора

Посмотрим информацию об основных характеристиках на сайте производителя, и определим, в чем отличие процессоров.

| E5-2630v2 | E5-2630v3 | |

| Кэш-память процессора | 15 MB | 20 MB |

| Скорость шины | 7.2 GT/s | 8 GT/s |

| Расширение набора команд | AVX | AVX2.0 |

| Количество ядер | 6 | 8 |

| Базовая тактовая частота процессора | 2.6 GHz | 2.4 GHz |

| Максимальная частота процессора (Turbo Boost) | 3.1 GHz | 3.2 GHz |

GT/s — гигатранзакции в секунду — единица измерения, определяющая количество произведённых операций по пересылке данных в секунду.

Какой вывод можно сделать? Компания Intel добавила в новый процессор кэш-память и продолжила идти по пути увлечения числа ядер. При этом они даже понизили основную тактовую частоту. Не смотря на это, максимальная частота при использовании технологии Turbo Boost на новых процессорах стала даже больше.

Можно предположить, что рабочая частота была понижена для снижения энергопотребления и уменьшения выделяемого тепла. Известно, что одна из основных проблем при уплотнении элементов (возрастании числа транзисторов на единицу площади) связанна с отводом тепла от них, так как тепловыделение отдельного транзистора не уменьшается.

Turbo Boost и AVX 2.0

В каждой новой линейке процессоров, Intel внедряет в архитектуру процессора новые оптимизации. С выпуском Haswell компания представила расширение системы команд — AVX 2.0.

Расширение AVX 2.0 (Advanced Vector Extensions) пришло на смену первой версии AVX. Новые возможности этого набора связаны с обработкой процессорных команд на низком уровне:

- Добавлена поддержка GATHER-инструкций. Это позволяет распределять данные по «разным» адресам памяти, а не обязательно непрерывно.

- Добавлены инструкций манипуляций/операций над битами.

- Добавлена поддержка 256-битных целочисленных векторов, вместо 128.

При разработке линейки Haswell учитывалось, что именно приложения с высокой степенью параллелизации сильнее всего нагружают процессор. Пока процессор интенсивно исполняет векторные задачи (AVX-инструкции), тактовая частота может быть понижена, чтобы процессор оставался в рамках своего теплопакета (TDP). Попросту говоря, чтобы процессор не перегрелся.

В чём же смысл введения новых команд, если для их исполнения процессор «замедляется»? На самом деле, процессор может работать либо в обычном, либо в AVX-режиме. Снижение частоты происходит только режиме AVX. В нём процессор эффективнее отрабатывает специфические команды, что в итоге позволяет увеличить общую производительность даже при снижении частоты.

Итоговая частота процессора зависит от большого количества факторов:

- режим AVX / не-AVX и количество ядер в этих режимах

- количество процессоров, используемых приложением

- общая загрузка процессора

- использование технологии Tubo Boost

Turbo Boost повышает производительность процессора и графики при пиковых нагрузках, автоматически разгоняя ядра процессора до частоты выше базовой, если мощность, потребляемый ток и температура не превышают максимальных значений.

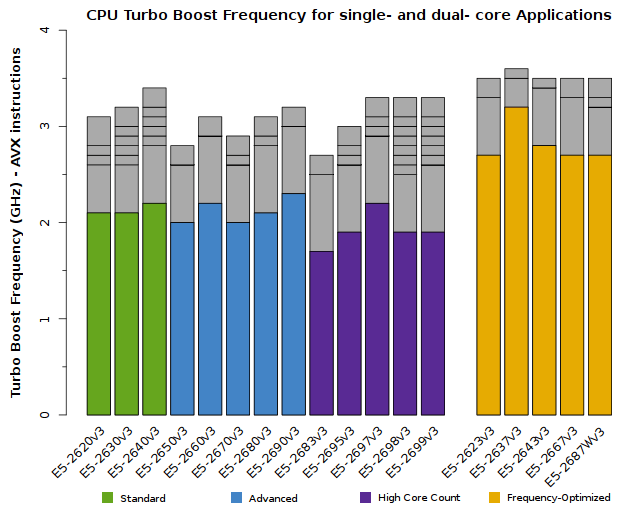

Ниже приведен график с частотой одного ядра для приложений, использующих режим AVX.

Верхняя граница цветной полосы показывает наихудший сценарий (ниже этого значения частота упасть не может). Серым цветом показана ожидаемая частота для большинства нагрузок. Серые полосы делятся на секторы по количеству используемых приложением ядер: верхние секторы для 1- и 2-ядерных приложений, нижние — для 8-ядерных.

Из-за большого количества факторов компания Intel отказывается называть реальные значения частоты даже жёстко заданных режимов работы. В итоге значение частоты становится диапазоном возможных значений.

Новая оперативная память DDR4

Новый процессор так же работает только с памятью DDR4 вместо DDR3. Давайте возьмём конфигурации из начала статьи:

|

Конфигурация со старым процессором Version: Intel(R) Xeon(R) CPU E5-2630 v2 @ 2.60GHz Память: |

Конфигурация с новым процессором Version: Intel(R) Xeon(R) CPU E5-2630 v3 @ 2.40GHz Память: |

Чем отличается память DDR4 от DDR3, кроме увлечения частоты? У памяти DDR4 меньшее рабочее напряжение, как следствие меньшее энергопотребление и меньший нагрев.

Изменение в организации чипов памяти. При равном объеме чип DDR4 будет иметь в два раза больше банков памяти и строки памяти в четыре раза короче. Это говорит о том, что память может переключаться между банками намного быстрее, чем DDR3. Соответственно вырастает скорость показателя tFAW (Four-bank Activation Window): для 8 Гб x4 DDR4 чипов показатель равен 20ns против 40ns у DDR3. Это означает, что DDR4 чипы памяти могут открывать произвольные строки в разных банках в два раза быстрее, чем DDR3.

Также в архитектуру были внесены изменения для повышения надежности благодаря введению механизма контроля чётности на шинах адреса и команд и режиму тестирования соединений.

Однако не обходится без недостатков: на DDR4 более высокие задержки (взаимодействия процессора с памятью, CAS Latency): примерно 15 против 11 на DDR3. Повторяется ситуация которая была при переходе с DDR2 на DDR3. Скорее всего, увеличение задержки связано с повышением надёжности: банки памяти DDR4 умеют обнаруживать и корректировать ошибки, связанные с контролем четности команд и адресов.

CAS Latency — это период ожидания (в циклах) между запросом процессора на получение содержимого ячейки памяти и временем, когда оперативная память сделает доступной для чтения первую ячейку запрошенного адреса.

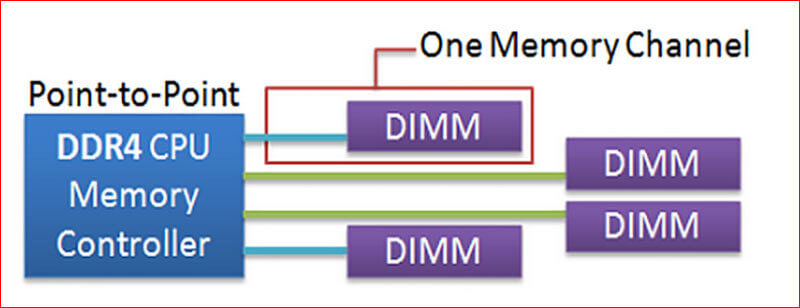

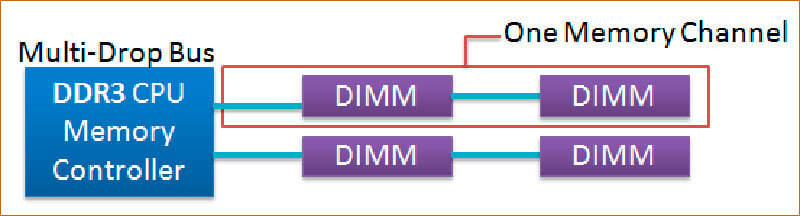

Однако самое вкусное преимущество DDR4 мы оставили напоследок. Если раньше память работала на шине Multi-Drop и только в двухканальном режиме, то теперь используется шина Point-to-Point, где для каждого разъема памяти отведён отдельный канал.

Соответственно, при использовании 4 модулей памяти каждые 2 модуля работали с общим каналом, что плохо сказывалось на производительности подсистемы памяти. Теперь же каждый модуль памяти работает по собственному каналу.

Все эти и другие возможности направлены на то, чтобы обеспечить рост рабочих частот и объемов памяти (связанные с ростом количества ошибок в работе), при этом гарантируя стабильную работу.

Заключение

Давайте обобщим возможности процессора Intel Xeon E5-2630v3 (не только те, которые появились при переходе от предыдущей версии Ivy Bridge, но и те, которые присущи процессорам Xeon в целом):

- Поддержка 4-канальной DDR4 памяти со скоростью до 2133 МГц

- Прямое подключение PCI-Express 3.0 между процессорами и периферическими устройствами (сетевыми адаптерами, графическими адаптерами и сопроцессорами)

- Расширение команд AVX 2.0

- Технология Turbo Boost (которая теперь зависит от режима AVX/не-AVX)

- Шина QPI (Dual Quick Path Interconnect), соединяющая сокеты процессоров — увеличивает скорость связи для многопоточных приложений

- Улучшенное энергосбережение, обеспечиваемое Per Core P-States. Позволяет всем ядрам работать на независимых частотах / вольтажах.

- Набор инструкций AES-NI (Advanced Encryption Standard New Instructions) для аппаратного шифрования и расшифровки.

- Технология Hyper-Threading добавляет виртуальные ядра, благодаря которой два потока могут быть запущены на одном физическом ядре для более эффективного его использования.

- Набор технологий, связанных с аппаратной виртуализацией: Intel Virtualization Technology (Directed I/O и Connectivity), APIC Virtualization. Без них виртуализация KVM просто не существовала бы.

Intel Xeon разрабатывался в качестве серверного процессора, и по характеристикам конкретной модели это очень хорошо заметно: большое количество ядер, ориентация на мультизадачность и мультипоточность, ускоренная обработка однотипных операций. Сервер на базе процессора Intel Xeon E5 отлично справляется с задачами хостинга (и в качестве «папы» для виртуальных серверов, и в качестве выделенного сервера).

На проекте FirstVDS мы начали вводить в эксплуатацию платформы с процессорами Xeon E5v3 в 2014 году. За это время с ними не было выявлено проблем. Данные мониторинга показывают прирост производительности по сравнению с нодами на процессах E5v2 при тех же нагрузках. Поэтому мы производим постепенное обновление парка, заменяя старые платформы новыми.